Coba bayangin skenario klasik zaman kuliah: ada satu mahasiswa jenius yang rajin banget belajar, baca semua buku, dan ngerjain riset berbulan-bulan sampai begadang. Terus, ada sekelompok mahasiswa lain yang pengen dapet nilai A juga, tapi males riset. Solusinya? Mereka nyontek jawaban si jenius, diubah dikit bahasanya biar nggak ketahuan dosen, lalu dikumpulin atas nama mereka sendiri.

Di dunia software engineering dan AI, praktik ini punya nama keren: Model Distillation. Dan baru-baru ini, Anthropic—pembuat Claude yang kita kenal puitis dan jago coding itu—ngamuk besar. Mereka secara terbuka menuduh DeepSeek dan dua perusahaan AI China lainnya melakukan operasi “nyontek” ini dalam skala industri yang masif.

Ini bukan sekadar satu atau dua developer iseng yang nyoba jailbreak prompt Claude. Kita bicara soal operasi terstruktur yang melibatkan puluhan ribu akun palsu. Sebagai developer yang tiap hari ngulik LLM, jujur aja, beritanya agak bikin “ngeri-ngeri sedap”. Kenapa? Karena ini membuktikan kalau perang AI sekarang bukan cuma adu chip NVIDIA H100, tapi udah masuk ke ranah adu licik dalam pengadaan data.

Mari kita bedah kasusnya sambil ngopi, karena detail teknisnya lumayan “daging”.

Operasi Skala Industri: Bukan Sekadar Scraping Biasa

Anthropic nggak main-main dalam laporannya. Mereka mendeteksi adanya kampanye terorganisir yang melibatkan sekitar 24.000 akun palsu. Akun-akun ini bukan bot sembarangan, tapi dirancang khusus untuk memanen respons dari Claude.

Totalnya? Lebih dari 16 juta percakapan (exchanges) terjadi antara bot-bot ini dengan server Claude.

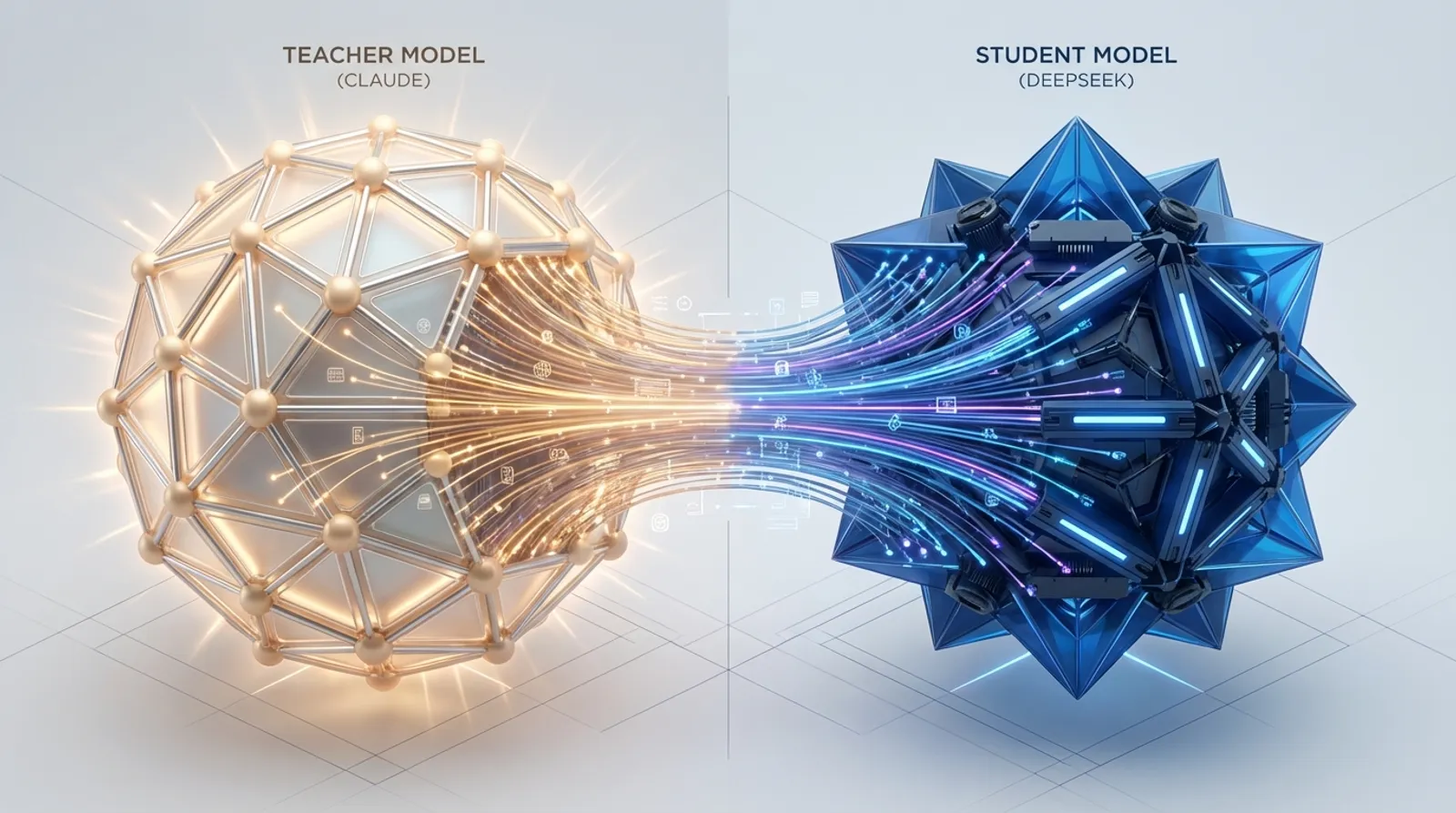

Tujuannya jelas: mengambil output berkualitas tinggi dari Claude (model “Guru”) untuk melatih model mereka sendiri (model “Murid”). Dalam machine learning, data hasil kurasi manusia itu mahal dan lambat didapat. Tapi kalau kalian bisa pakai AI secerdas Claude untuk men-generate data latihan? Itu ibarat jalan pintas super cepat dan murah.

Skala Operasi Distilasi (Berdasarkan Klaim Anthropic)

Kalau kalian lihat data di atas, mungkin mikir: “Lho, kok DeepSeek cuma 150 ribu exchange? Dikit banget dibanding MiniMax yang sampai 13 juta?”

Nah, di sinilah letak kecerdikan (atau kelicikan) strategi teknisnya. MiniMax dan Moonshot tampaknya main di volume—mengambil sebanyak mungkin data percakapan umum. Tapi DeepSeek? Mereka main sniper. Mereka menargetkan kualitas, bukan kuantitas.

DeepSeek dan Strategi “Cuci Otak” Politik

DeepSeek, yang belakangan ini viral banget di kalangan developer Indonesia karena performa modelnya yang efisien (dan murah), dituduh melakukan sesuatu yang lebih spesifik. Mereka nggak cuma minta Claude nulis puisi atau kode Python. Menurut Anthropic, DeepSeek secara agresif menargetkan kemampuan reasoning (penalaran) Claude.

Tapi yang bikin saya geleng-geleng kepala adalah tuduhan bahwa mereka menggunakan Claude untuk menghasilkan “alternatif jawaban yang aman sensor”.

Gini logika teknisnya:

- DeepSeek mengajukan pertanyaan sensitif secara politik (misalnya tentang pembangkang politik, pemimpin partai, atau otoritarianisme) ke Claude.

- Claude, sebagai model Barat yang dilatih dengan nilai kebebasan berekspresi, memberikan jawaban faktual dan terbuka.

- DeepSeek kemudian memproses jawaban ini, lalu melatih model mereka sendiri untuk mengenali topik tersebut tapi memberikan respons yang “sudah disanitasi” atau sesuai dengan narasi sensor negara asal mereka.

Jadi, mereka menggunakan kecerdasan Claude untuk memahami konteks sensitif, supaya AI mereka bisa lebih pinter dalam… ngeles.

Apa itu Model Distillation?

Dalam konteks AI, Distillation adalah teknik mentransfer pengetahuan dari model besar (Teacher, misal: Claude 3.5 Sonnet) ke model yang lebih kecil (Student).

Biasanya ini teknik sah untuk efisiensi (kompresi model). Tapi, ketika dilakukan tanpa izin untuk meniru kemampuan kompetitor, ini dianggap sebagai pencurian properti intelektual. Bahayanya, model “Student” seringkali menyerap kecerdasan model “Teacher” tapi gagal menyerap fitur keamanannya (safety guardrails).

Kenapa Anthropic (dan OpenAI) Sangat Marah?

Kalian mungkin mikir, “Ah, namanya juga open source intelligence, wajar dong belajar dari yang lebih pinter?”

Masalahnya ada di biaya dan keamanan. Anthropic dan OpenAI menghabiskan triliunan rupiah untuk compute power (listrik, GPU) dan human feedback (RLHF) untuk bikin model mereka aman dan pintar.

Kalau kompetitor cuma modal API call (atau akun gratisan yang di-bot) untuk menyedot “sari pati” kecerdasan itu, mereka bisa bikin model dengan kemampuan setara tapi dengan modal sepersekian persennya saja. Anthropic menyebut ini sebagai jalan pintas untuk mendapatkan kapabilitas frontier AI tanpa harus keluar duit dan waktu untuk R&D mandiri.

Lebih parah lagi, Anthropic menyoroti risiko keamanannya. Ketika sebuah lab asing melakukan distilasi model Amerika, mereka bisa memasukkan kapabilitas canggih ini ke dalam sistem militer, intelijen, atau pengawasan massal. Karena proses distilasi seringkali menghilangkan “safety filter” asli, model hasil curian ini jadi senjata yang powerful tapi liar—sempurna untuk operasi siber ofensif atau kampanye disinformasi.

Ini bukan pertama kalinya kita dengar keluhan ini. Belum lama ini, OpenAI juga mengirim surat ke pembuat kebijakan di Amerika, menuduh DeepSeek melakukan praktik free-riding alias nebeng kapabilitas yang dikembangkan lab-lab di AS.

Dampaknya Buat Kita, Para Developer?

Oke, lepas dari drama geopolitik antara AS dan China, apa artinya ini buat kita yang sehari-hari ngoding pake AI?

Pertama, validasi kualitas. Tuduhan ini secara tidak langsung mengonfirmasi bahwa Claude memang dianggap sebagai “standar emas” untuk kemampuan reasoning. Bahkan kompetitor pun merasa perlu “berguru” (baca: nyontek) ke Claude untuk ningkatin logika model mereka. Buat saya pribadi, ini makin meyakinkan untuk tetap pakai Claude di workflow coding yang kompleks.

Kedua, skeptisisme terhadap model “terlalu murah untuk jadi kenyataan”. DeepSeek sempat mengguncang pasar karena performanya yang gila dengan harga token yang sangat murah. Kalau ternyata sebagian “kecerdasan” itu didapat dari hasil distilasi model lain, wajar kalau harganya bisa ditekan. R&D cost-nya di-subsidi oleh Anthropic dan OpenAI tanpa izin.

Ketiga, masa depan akses API. Dengan adanya kasus “serangan” 24.000 akun palsu ini, jangan kaget kalau kedepannya proses verifikasi untuk akses API atau akun Claude bakal makin ribet. Kita yang beneran developer jujur mungkin bakal kena imbas pemeriksaan keamanan yang lebih ketat gara-gara ulah “petani data” ini.

Anthropic sekarang mendesak penyedia cloud dan pembuat kebijakan untuk bertindak. Mereka bahkan menyinggung soal pembatasan akses chip sebagai cara untuk mengerem laju “distilasi ilegal” ini.

Sebagai penutup, inovasi itu memang butuh inspirasi. Tapi ada garis tipis antara “terinspirasi” dan “menyalin”. Di dunia AI yang pergerakannya secepat kilat, sepertinya etika masih jadi barang mewah yang sering dilupakan demi mengejar benchmark.

Gimana menurut kalian? Apakah praktik distilasi ini “smart move” dalam kompetisi bisnis, atau murni kecurangan yang harus dibasmi?