Banyak dari kita masih merasa aman menggunakan nama samaran atau avatar anonim di forum internet, merasa identitas asli terlindungi di balik username unik. Selama ini, privasi digital sering kali bergantung pada konsep practical obscurity—data kita mungkin tersedia secara publik, namun sulit untuk dikumpulkan dan dihubungkan secara manual oleh manusia.

Namun, perlindungan yang bersifat pasif ini tampaknya mulai menemui titik akhir.

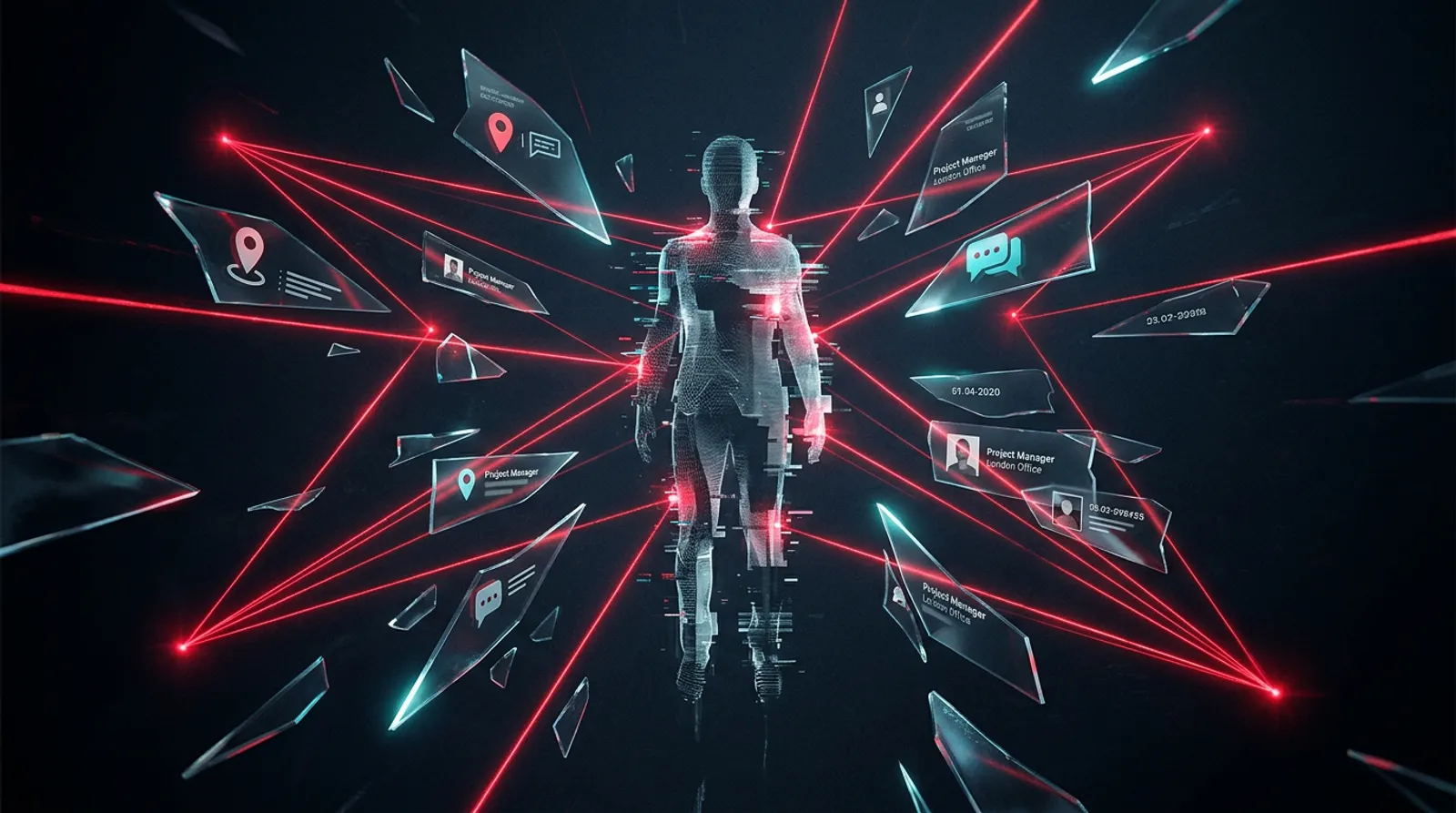

Sebuah riset keamanan terbaru yang dirilis pada awal 2026 mengungkapkan fakta yang cukup mengkhawatirkan bagi komunitas keamanan siber. Large Language Models (LLM) komersial yang kini umum digunakan ternyata dapat diprogram menjadi mesin deanonimisasi otomatis. Tanpa memerlukan keahlian teknis tingkat tinggi atau akses ke basis data bocor, AI mampu mengungkap identitas asli pengguna hanya dengan menganalisis jejak digital publik dengan biaya yang sangat terjangkau.

Ini bukan sekadar bukti bahwa AI semakin cerdas, melainkan pergeseran fundamental dalam lanskap ancaman privasi bagi siapa pun yang ingin tetap anonim di dunia maya.

ESRC: Kerangka Kerja Detektif AI

Secara tradisional, melakukan OSINT (Open Source Intelligence) untuk melacak identitas seseorang merupakan proses yang melelahkan. Seorang analis harus menyisir ribuan data secara manual, menghubungkan satu komentar di forum tahun 2020 dengan profil profesional di platform seperti LinkedIn tahun 2024. Proses ini membutuhkan waktu berjam-jam, ketelitian tinggi, dan sering kali berujung pada jalan buntu.

Namun, para peneliti dari ETH Zurich dan Anthropic berhasil menyederhanakan proses ini melalui kerangka kerja serangan baru yang disebut ESRC (Extract, Search, Reason, Calibrate).

Mekanisme Serangan ESRC

Extract | Menarik sinyal identitas (hobi, lokasi, gaya bahasa) dari teks mentah. |

Search | Mencari profil dunia nyata yang cocok melalui kueri mesin pencari. |

Reason | AI menalar kecocokan antara persona online dan profil asli. |

Calibrate | Menghitung skor keyakinan (confidence score) untuk memastikan akurasi. |

Sederhananya, sistem ini bertindak seperti detektif digital dengan ingatan fotografis dan kemampuan memproses data yang masif dalam hitungan detik. AI tidak perlu mendengar Anda menyebutkan nama asli untuk mengetahui siapa Anda.

Cukup dengan menghubungkan informasi-informasi kecil yang tersebar—misalnya, ketertarikan Anda pada lokasi spesifik di satu forum dan riwayat pendidikan atau sertifikasi profesional di platform lain. Bagi manusia, potongan informasi ini mungkin tampak tidak berhubungan. Namun, bagi LLM dengan framework ESRC, ini adalah sidik jari digital yang unik. AI dapat dengan cepat mencocokkan pola tersebut dengan profil di LinkedIn atau platform media sosial lainnya.

Efisiensi yang Mengkhawatirkan

Aspek yang paling mengkhawatirkan dari temuan ini bukanlah sekadar kemampuannya, melainkan efisiensi dan biaya rendah yang dibutuhkan. Jika dahulu deanonimisasi membutuhkan sumber daya manusia yang besar (man-hours), kini proses tersebut dapat dilakukan secara otomatis dengan biaya yang sangat minim.

Statistik Serangan Deanonimisasi

Bayangkan, dengan biaya berkisar antara Rp22.000 hingga Rp60.000 per target, pelaku ancaman dapat membongkar identitas seseorang secara massal. Dalam eksperimen yang dilakukan, AI berhasil mencocokkan profil anonim dari platform Hacker News ke profil LinkedIn asli dengan tingkat keberhasilan hampir 70% dari puluhan ribu kandidat profil.

Rendahnya hambatan masuk ini memungkinkan siapa pun dengan akses ke API LLM untuk melakukan profiling massal. Privasi yang dahulu terlindungi oleh “kemalasan” manusia kini terancam oleh skalabilitas mesin.

Keterbatasan Filter Keamanan

Sering kali muncul anggapan bahwa model AI populer memiliki filter keamanan (safety guardrails) yang akan mencegah penyalahgunaan semacam ini. Namun, riset ini membuktikan bahwa perlindungan tersebut masih sangat rentan.

Para peneliti menemukan bahwa filter keamanan pada model seperti GPT atau Claude dapat dilewati hanya dengan mengubah struktur instruksi (prompt engineering). Tanpa perlu teknik peretasan yang rumit, pengguna bisa mengubah konteks permintaan seolah-olah merupakan tugas analisis data biasa, dan AI akan tetap memproses data privasi tersebut.

Berakhirnya Practical Obscurity

Istilah “Practical Obscurity” merujuk pada privasi yang kita miliki karena data kita sulit ditemukan atau dihubungkan, meski tersedia secara publik. Riset ini secara efektif mengakhiri konsep tersebut. Di era AI, data yang bersifat publik dapat dihubungkan secara instan.

Dampak dan Risiko di Indonesia

Fenomena ini membawa risiko nyata bagi pengguna internet di Indonesia, terutama di tengah maraknya kasus penyalahgunaan data pribadi. Salah satu skenario yang paling mengkhawatirkan adalah potensi penyalahgunaan oleh pihak tidak bertanggung jawab, seperti pelaku penipuan digital atau layanan pinjaman daring (pinjol) ilegal.

Pelaku dapat dengan mudah melakukan scraping data dari komentar-komentar pengguna di media sosial, menjalankan kerangka kerja ESRC, dan mengungkap informasi sensitif seperti tempat kerja, lokasi sekolah anggota keluarga, hingga kebiasaan harian korban untuk melakukan intimidasi.

Secara hukum, Indonesia telah memiliki UU No. 27 Tahun 2022 tentang Perlindungan Data Pribadi (UU PDP). Undang-undang ini mengatur ketat mengenai praktik profiling otomatis yang dapat berdampak signifikan bagi subjek data. Namun, tantangan terbesarnya tetap pada penegakan hukum terhadap pelaku kejahatan siber lintas batas atau anonim yang tidak memedulikan regulasi.

Langkah Mitigasi

Meskipun sulit untuk menghapus jejak digital sepenuhnya, ada beberapa prinsip keamanan operasional (OpSec) yang dapat mulai diterapkan untuk meminimalisir risiko:

- Fragmentasi Identitas: Hindari penggunaan nama pengguna (username) yang sama di berbagai platform yang berbeda. Pisahkan identitas untuk hobi, pekerjaan, dan opini publik.

- Kurangi Berbagi Informasi Berlebih (Oversharing): Informasi kecil seperti lokasi spesifik, jam kegiatan, atau pencapaian profesional tertentu dapat menjadi titik data yang valid bagi AI untuk melakukan deanonimisasi.

- Kesadaran Digital: Pahami bahwa setiap teks yang Anda unggah secara publik kini dapat diolah oleh mesin dengan kemampuan analisis yang jauh melampaui manusia.

Era anonimitas mutlak di internet mungkin sudah berlalu. Sekarang, kita berhadapan dengan teknologi yang mampu menyusun kepingan teka-teki digital kita dengan kecepatan luar biasa. Kesadaran dalam berbagi informasi menjadi benteng terakhir kita di era kecerdasan buatan.